大模型的价值,正在从“能不能用”,转向“能不能管、敢不敢用、算不算得清”。

过去一年,企业对大模型的态度发生了一个非常明显的变化:

从最初的PoC验证、部门级试点,逐步走向真实生产环境、规模化应用、跨系统协同。而在这个过程中,一个现实问题越来越无法回避——大模型能力已经进入企业核心IT架构,企业是否能管得住,风险是不是可控?

正是在这样的背景下,RestCloud企业级AI网关正式发布。

这不是一个“为了AI而AI”的新概念组件,而是RestCloud在iPaaS+API管理+AI 工程化多年实践基础上,对企业真实需求的一次系统性回应。

为什么企业“迟早都要一个AI网关”?

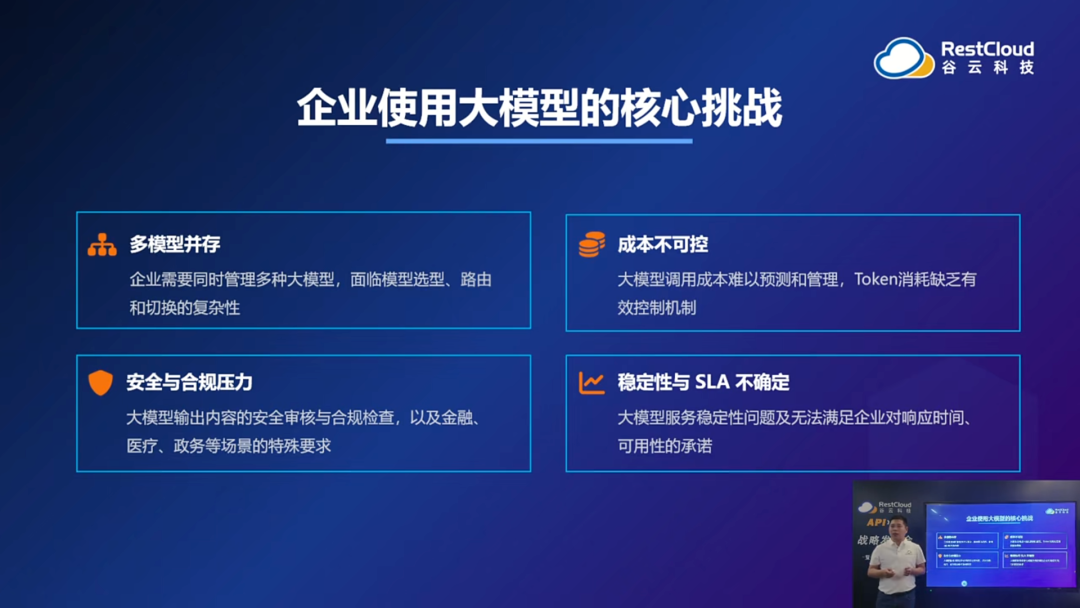

在企业环境中,大模型的调用早已不是“一个API Key的问题”,往往是面对多个问题:

多模型并存管理复杂:不同模型之间接口不一、能力参差,模型切换与路由策略难以统一;

成本难以预测与控制:Token消耗波动大,缺乏精细化管控机制,易造成资源浪费与预算超支;

安全与合规压力骤增:尤其在金融、医疗、政务等高监管场景,输出内容审核与数据隐私保护成为刚需;

稳定性与SLA保障不足:大模型服务响应不稳定,难以满足企业生产环境对高可用与性能承诺的要求。

传统API网关虽能处理常规接口流量,却难以适应AI场景特有的高并发、长连接、大Token、高延时容忍等需求。企业亟需一个真正“懂AI的网关”,而AI网关,正是这个治理体系中不可或缺的一环,也是企业级AI大规模应用的基础设施。

承载企业级AI应用的专业网关基础设施

RestCloud并未将AI网关定位为传统API网关上的一次功能叠加或能力扩展。

相反,RestCloud企业级AI网关从架构层面独立设计,专门面向大模型推理场景,能够承载高并发、长连接、高延时、大Token负载的AI应用访问需求,是一个具备独立运行能力的专业级AI基础设施组件。

它并不依附于原有API网关运行,也不受限于传统Web API的流量模型,而是围绕模型调用特性、Token资源管理、内容安全、推理稳定性和成本控制等关键问题,重新设计了网关能力边界。

与此同时,企业级AI网关可以与现有iPaaS体系中的API编排以及API网关形成紧密协同:

由iPaaS负责业务流程、系统集成与AI能力的编排;

由API网关承担传统业务接口的统一接入与治理;

由AI网关专注承载和治理大模型推理流量与 AI 能力调用。

三者协同工作,使AI能力能够自然融入企业既有的集成架构与业务流程之中。

企业级AI网关让大模型调用,从“不可控的外部能力”,变成“可治理的企业基础设施”。

发布即落地,RestCloud AI网关解决的不是概念,而是工程问题

1.多模型统一接入,真正做到“模型可替换”

在企业环境中,“选模型”从来不是一次性决策。

RestCloud AI网关支持:

同一业务接口,按策略路由至不同模型;

模型失败自动Fallback,避免业务中断;

新模型灰度接入、效果评估、无侵入切换;

业务系统不再关心模型厂商,只关心能力与SLA。

2.企业级消费者鉴权,而不是“谁拿到Key谁就能用”

在RestCloud AI网关中,大模型调用具备完整的企业级身份语义:

按部门/系统/人员分配API Key;

基于RBAC控制模型、能力、参数范围;

不同角色,用不同模型、不同Token配额;

这解决的不是“技术问题”,而是管理问题,高成本模型,只能用在高价值场景上。

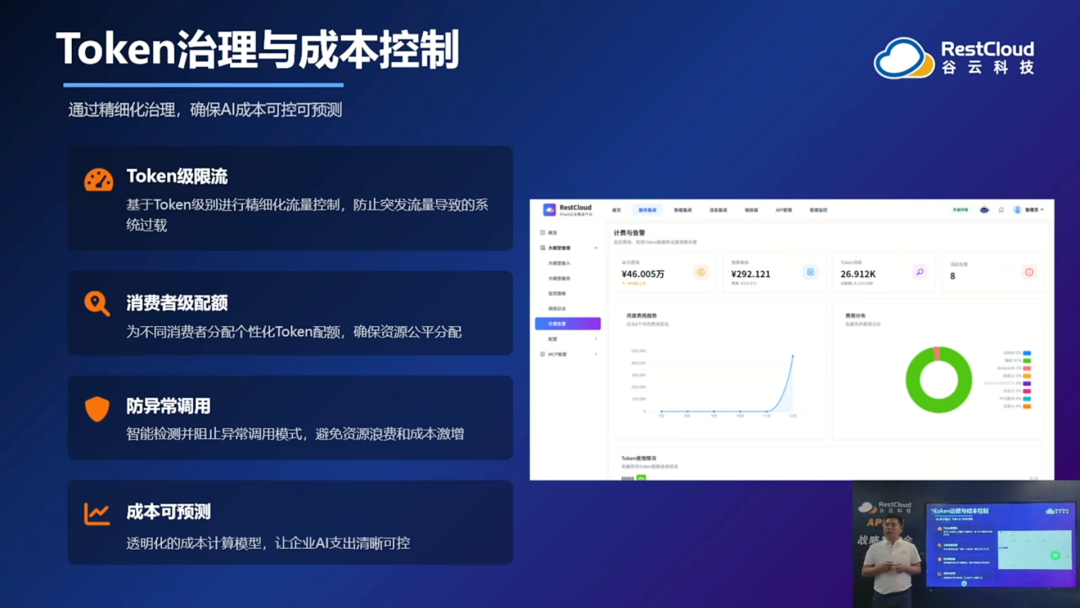

3.Token级治理:这是企业真正关心的“成本开关”

大模型成本不可控,根本原因不在模型,而在缺乏Token级治理能力。

RestCloud AI网关支持:

基于Consumer/API/场景的Token限流;

防止异常Prompt、恶意调用导致资损;

支持容量规划,而不是盲目堆硬件。

4.内容安全与合规前置,而不是“事后补救”

在企业场景下,大模型的风险并不抽象:

金融合规、医疗隐私、政务内容、内部敏感信息泄露;

RestCloud AI网关将内容安全放在网关层,而不是模型之后;

输入指令审核、输出结果合规校验、风险可追溯、可审计;

模型负责“智能”,网关负责“底线”。

5.语义缓存:第一次为“AI 成本”提供系统性解法

不同于传统HTTP缓存,RestCloud AI网关引入的是:面向语义的缓存机制,支持高频问题、固定上下文、RAG检索结果复用,显著降低Token消耗与响应时延,这意味着:企业第一次可以系统性地优化“大模型推理成本”。

6.AI可观测:让每一个Token都有来处

在RestCloud AI网关中,可观测不再只是QPS和RT,而是:

谁在用模型?

用了多少 Token?

哪个模型最贵?

哪些调用被限流?

哪些请求命中了缓存?

哪些触发了安全策略?

这是运维、财务、管理层都看得懂的AI运行视图。

为什么这些能力一定要放在“网关层”?

RestCloud在设计之初就明确了一点:不能把治理复杂度压给模型服务层。

原因很简单:

模型层应该专注推理,而不是承担鉴权、限流、审计;

治理能力需要统一,而不是分散在各模型中;

AI能力一定会演进,但治理逻辑必须长期稳定;

因此,RestCloud AI网关采用插件化、可热更新的方式交付能力:

即插即用;

不侵入业务;

不绑定模型;

决定企业AI成败的,不再是模型能力,而是工程与治理能力

在当前阶段,大模型能力本身正在快速趋同。无论是通用模型、行业模型还是自建模型,企业已经不缺“可用的模型”,真正的挑战开始集中在工程层面:

能否在多业务、多系统、多部门场景下稳定承载大规模AI调用;

能否在保障安全与合规的前提下,对模型访问进行精细化管控;

能否对Token消耗、调用成本、模型效果进行持续监控与优化;

当模型能力、成本或稳定性发生变化时,能否在不改业务代码的情况下完成切换与调整;

这些问题,已经超出了模型本身的能力边界,本质上是企业级AI基础设施的问题。

RestCloud企业级AI网关,正是围绕这些工程与治理问题设计的产品形态。它并不试图替代模型,也不参与模型能力的竞争,而是通过统一的AI接入与治理层:

将分散、不可控的大模型调用收敛到可管理、可审计、可优化的统一入口;

将模型选择、限流策略、安全规则、成本控制从业务系统中解耦出来;

将AI能力纳入企业既有的iPaaS与API治理体系,形成长期可演进的技术底座;

因此,经过近一年不断迭代与研发RestCloud企业级AI网关是一个已经具备生产级稳定性、可以直接进入企业核心架构的AI基础设施组件,用于支撑AI在企业中的规模化落地与长期运行。